iOS/iPadOS 13では機械学習を利用したSiriの音声認識エンジンとアクセシビリティの音声コントロールにより、iPhoneやiPadのほぼ全ての操作を音声だけで行うことが可能になっています。詳細は以下から。

![]()

iOS 13/iPadOS 13がリリースされて以来、AppleのiWorkやAgilebitsの1Password、Shiny FrogのBearなど多くのアプリがアクセシビリティアップデートを提供していますが、これはiOS 13やiPadOS 13(macOS 10.15 Catalinaでも)でアップデートしたアクセシビリティの「音声コントロール」に対応するためで、

現在この機能は米国の英語に最適化されていますが、WWDC 2019でもIan Mackayさんが披露されたとおり、iOS 13/iPadOS 13のボイスコントロールは音声だけでiPhoneやiPadのほぼ全ての操作が可能になっています。

新しい音声コントロール

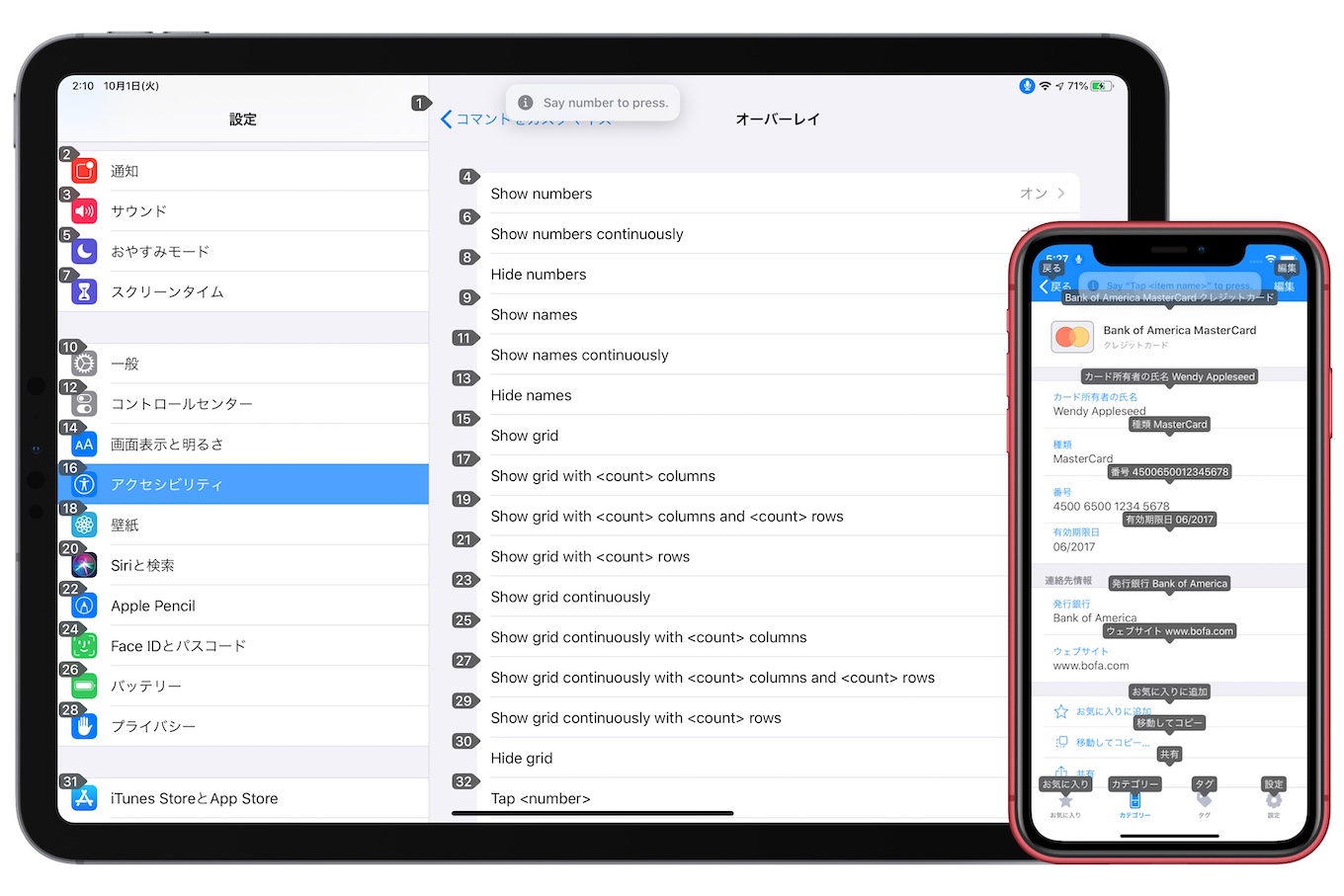

iOS 13ではiOS 12まではスイッチコントロールの1つだった音声コントロールが設定アプリ → [アクセシビリティ] → [音声コントロール]として独立しており、新しい音声コントロールには機械学習を用いた”Audio to Text”機能にSiriの音声認識エンジンが採用され、iOS/iPadOS上だけで音声をシームレスにテキストに変換でき、

現在は英語のみのサポートのため全ての機能を利用するには日本人の発音では難しいかもしれませんが、音声コントロールを有効にし“Show Number”や”Show Grid”と発音すればiPhone/iPadのディスプレイ上のどこの位置でもタップやスワイプを行うことが可能で、音声コントロールアップデートを施したアプリでは“Show Name”でアイテム名が表示されるので、アクセシビリティに配慮したアプリを利用している方は試してみてください。

おまけ

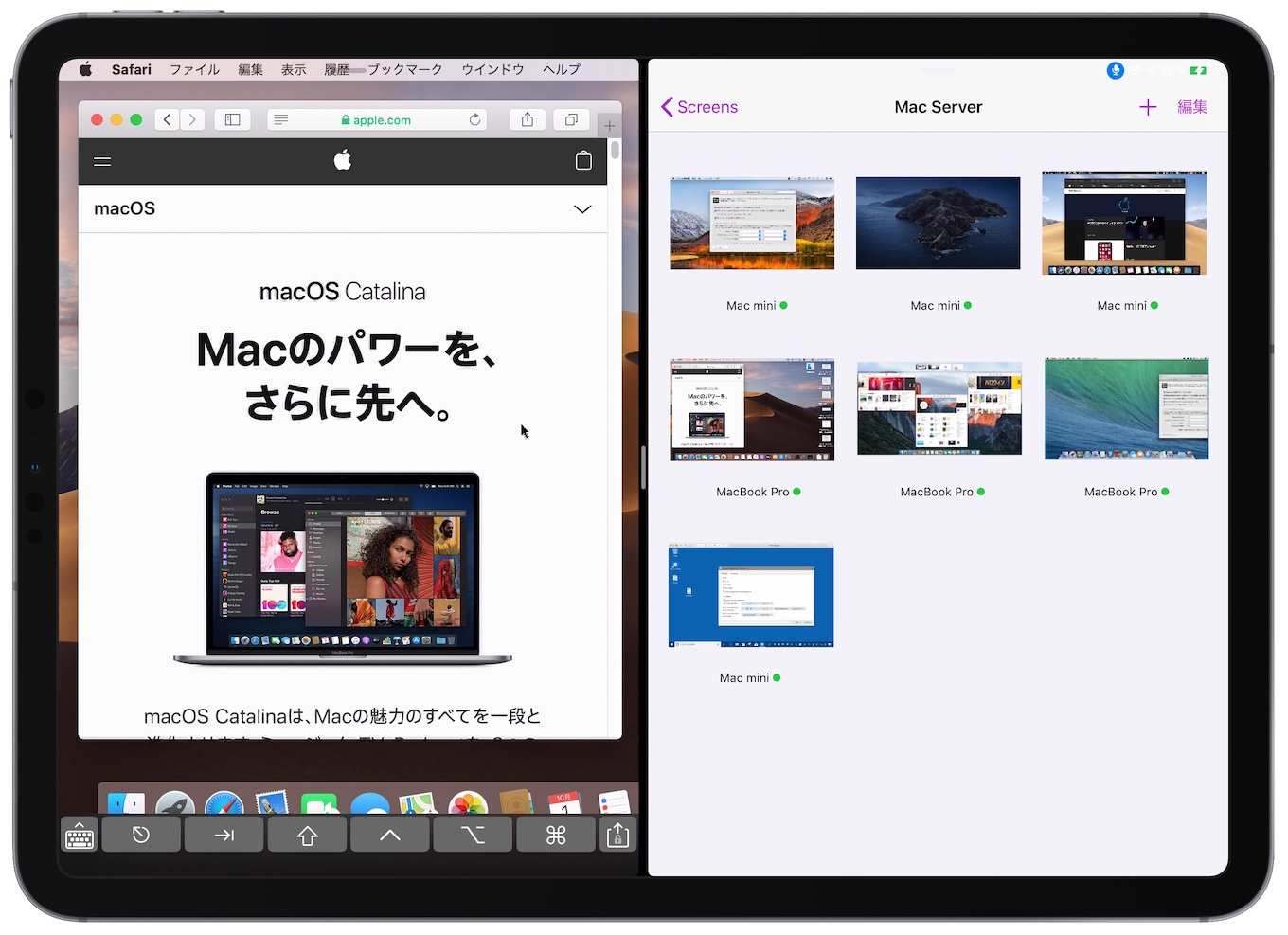

現在のところアップデートは配信されていないようですが、AdobeでVoice UIの研究&開発を担当しているCameron CundiffさんはmacOS 10.15 Catalina betaでAdobe XDの音声コントロールを利用して、音声だけでロゴを作成しているので、今後日本語に対応すればキーボードとマウスがなくても仕事ができると思われます。

Designed a logo completely hands free, using Voice Control on macOS #Catalina and @AdobeXD. Giddy!

video: time-lapse screencast, dictating commands to XD via macOS voice control, demonstrating the use of Number and Grid targeting to create overlapping shapes and type. pic.twitter.com/ij8okk3ztq

— Cameron Cundiff (@ckundo) June 29, 2019

コメント