iOS 26では機械学習を利用し、iPhoneのカメラのレンズ汚れを検知&ユーザーにレンズ掃除の提案をする「Lens Cleaning Hints」機能が追加されるそうです。詳細は以下から。

![]()

Appleは日本時間2025年06月10日午前02時から世界開発者会議(WWDC25)を開催し、その中で今年の秋にリリースを予定している「macOS 26 Tahoe」や「iOS/iPadOS 26」を発表しましたが、そのiOS 26では、iPhoneのカメラのレンズ汚れを検知して、ユーザーにレンズの掃除を提案する「Lens Cleaning Hints」機能が追加されるそうです。

WWDC25の基調講演より

Lens Smudge Detection

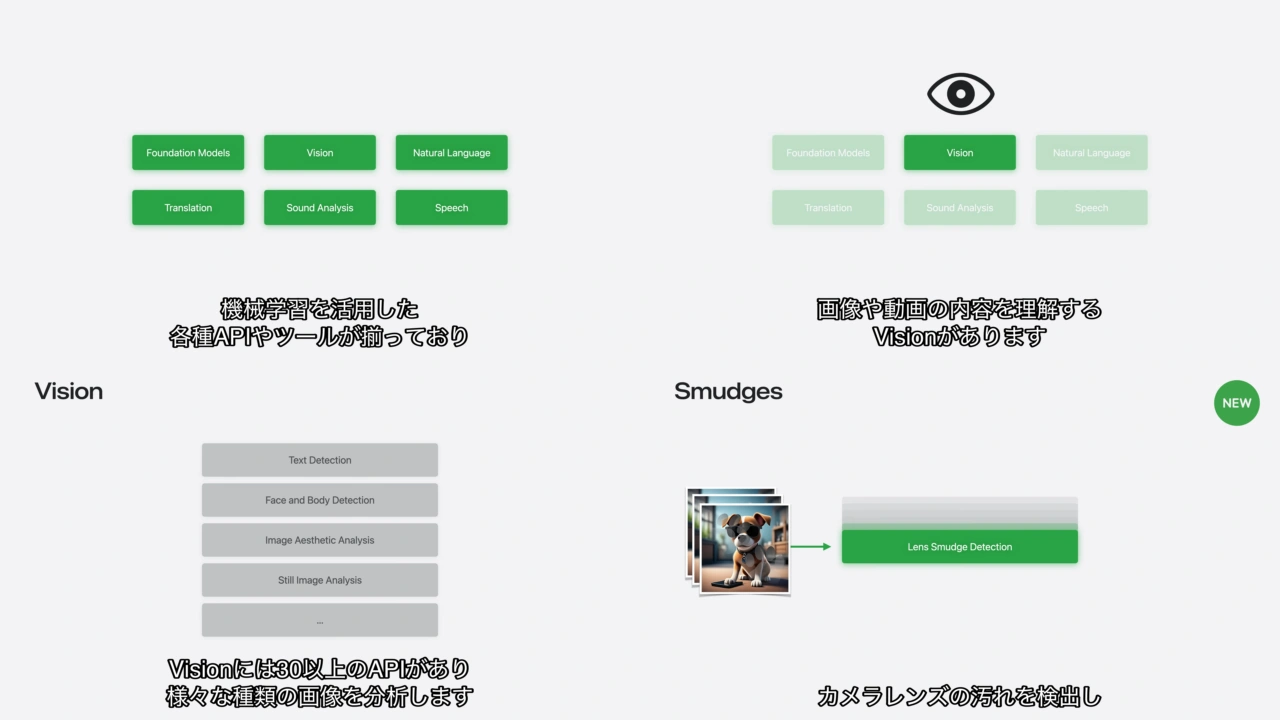

Appleが公開したWWDC25のセッション360「Discover machine learning & AI frameworks on Apple platforms」によると、iOS 26ではAppleの画像分析フレームワーク「Vision Framework」がアップデートされ、新たに「Document Recognition (文章認識)」と「Lens Smudge Detection (レンズ汚れ除去)」 APIが追加され、

Discover machine learning & AI frameworks on Apple platforms

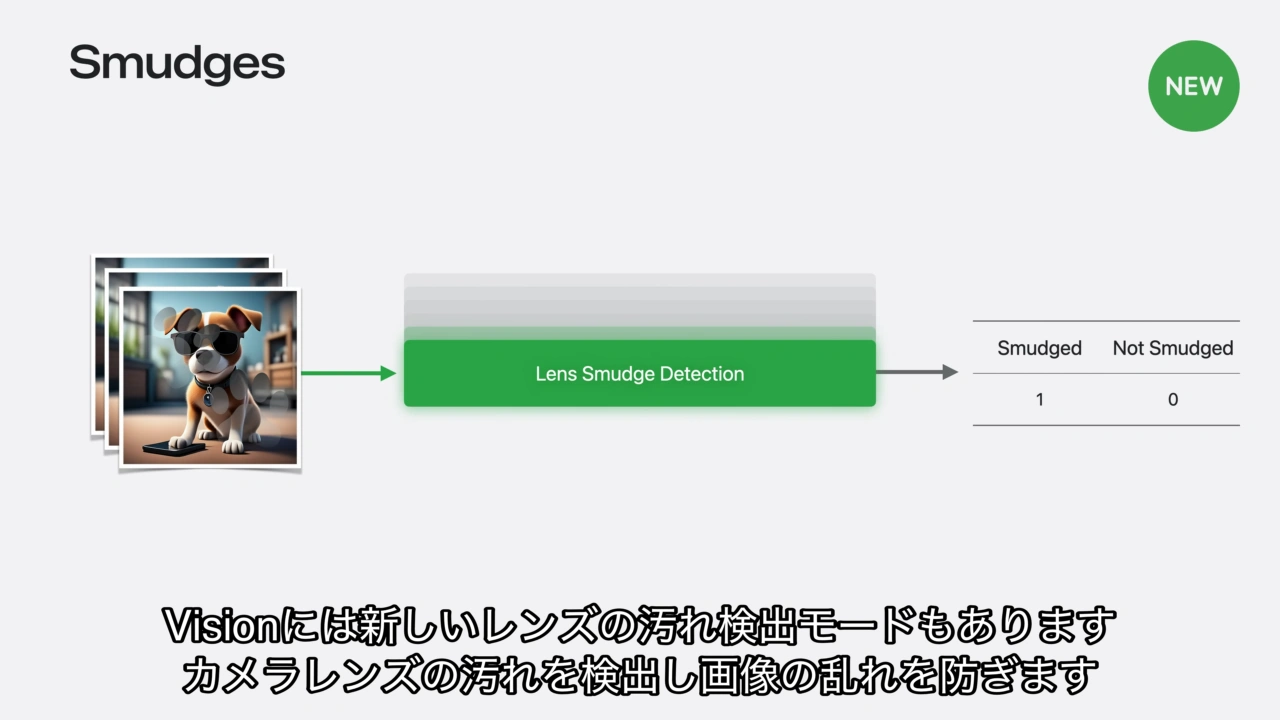

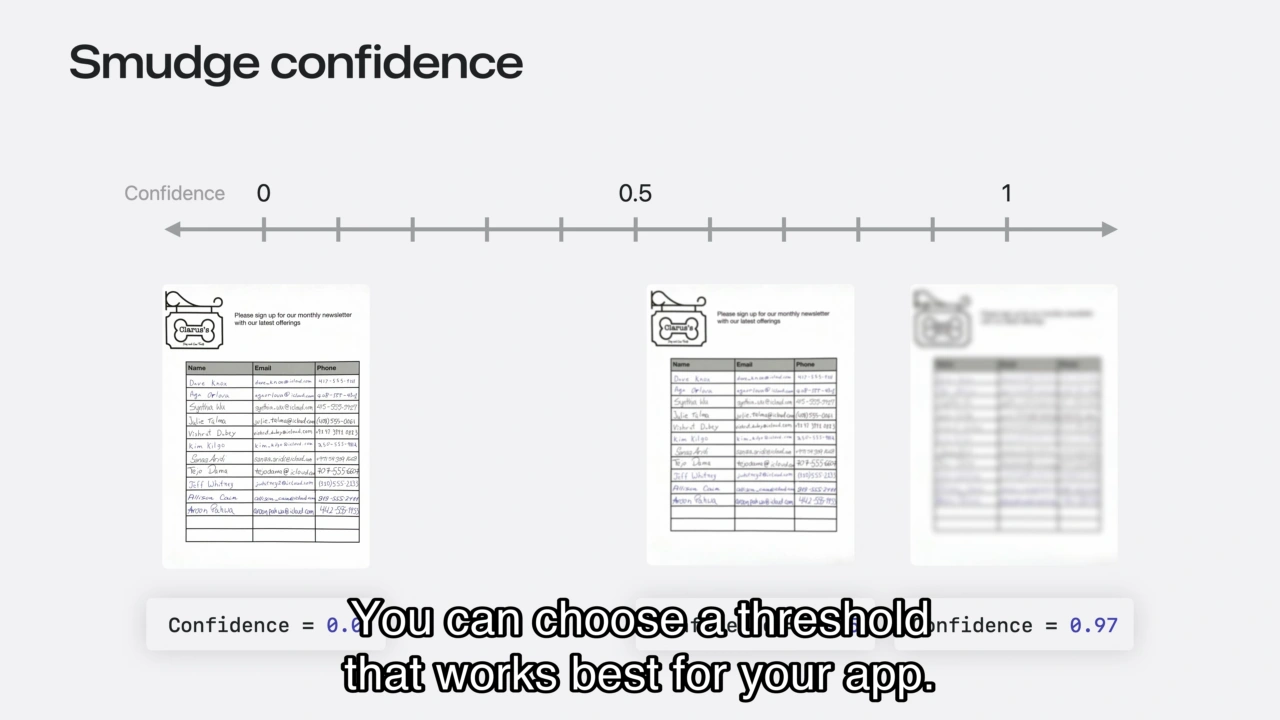

この2つのAPIの内、Lens Smudge Detectionはユーザーが撮影した複数の写真からオンデバイスの機械学習処理によりレンズについた汚れを検出し、汚れが一定の閾値を超えるとユーザーに対しレンズを掃除することで、より鮮明な写真を撮影できることを通知するそうです。

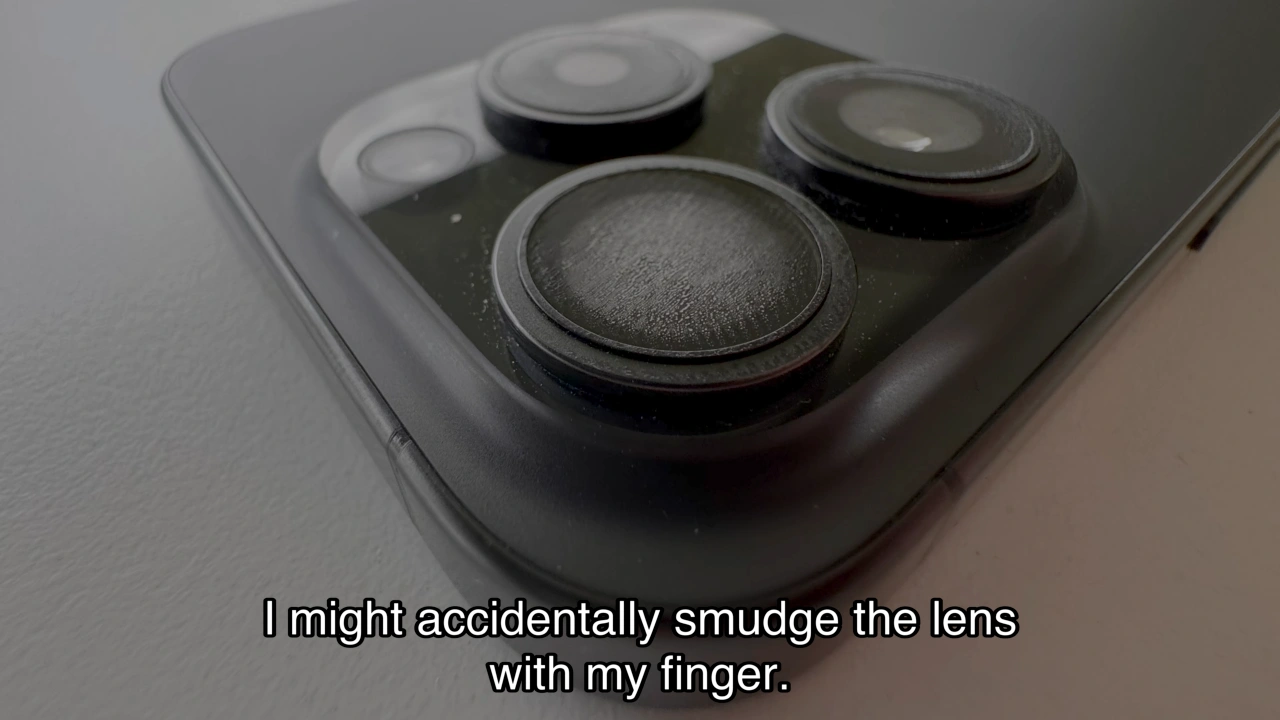

また、同時に公開されたセッション272「Read documents using the Vision framework」によると、このLens Smudge Detectionはユーザーが誤って指でレンズを触ってしまった際に付く汚れなども検出できるそうで、

Read documents using the Vision frameworkより

iOS 26の機能としてでなく、サードパーティアプリでもDetectLensSmudgeRequest APIを利用し設定した閾値以上のレンズ汚れになると、ユーザーにレンズを掃除し新しい写真を撮影するように通知できるそうなので、iOS 26ではレンズ汚れで顔や文字が見えないボヤケた写真を撮る確率が減るかもしれません。

Read documents using the Vision frameworkより

Appleプラットフォームでの機械学習の詳細

- What’s new in Machine learning & AI – Apple Developer

コメント