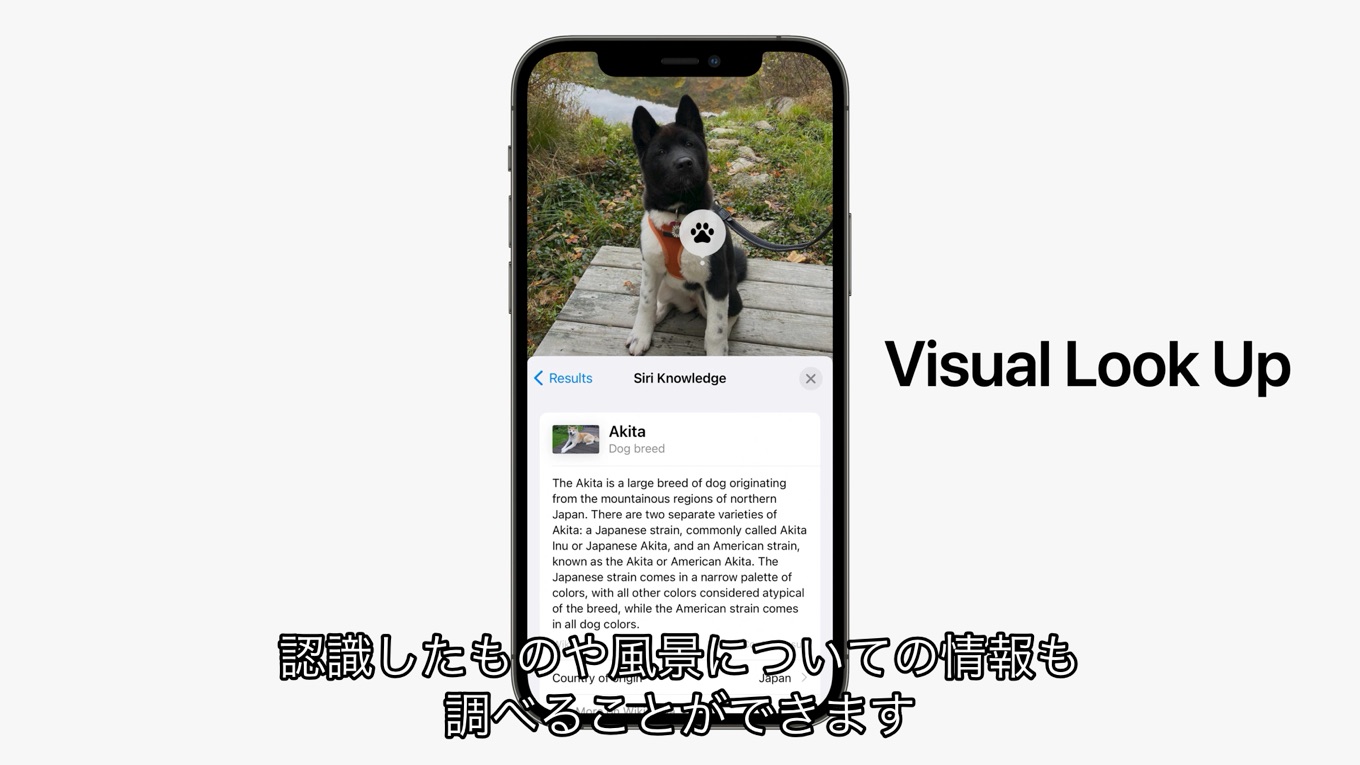

iOS 16では機械学習を利用し写真から犬や猫の品種、花の種類、アートや本のタイトル、建築物の詳細を表示する「Visual Look Up」が日本でも利用可能になっています。詳細は以下から。

![]()

Appleは2021年06月に開催したWWDC21の中で、iOSやmacOSの機械学習(Neural Engine)技術を利用し、写真内に写っているる犬や猫の品種、花の名前、アートや本のタイトル、建物の詳細を表示できる「画像を調べる (Visual Look Up)」機能を発表し、

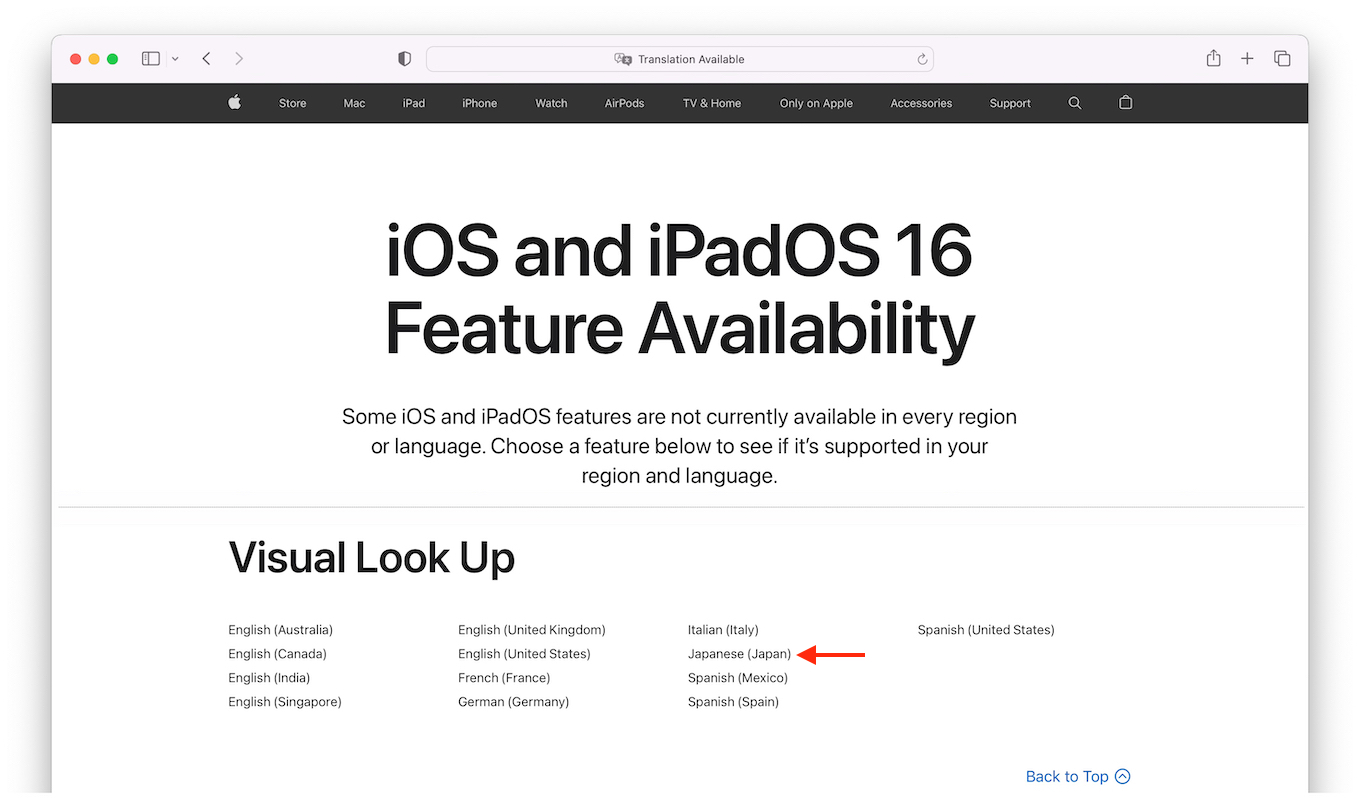

アメリカやカナダなど一部の英語圏と欧州で利用可能になっていましたが、現地時間2022年09月12日にリリースされた「iOS 16」では、このVisual Look Upが日本/日本語でも利用可能になっています。

Visual Look Upを使う

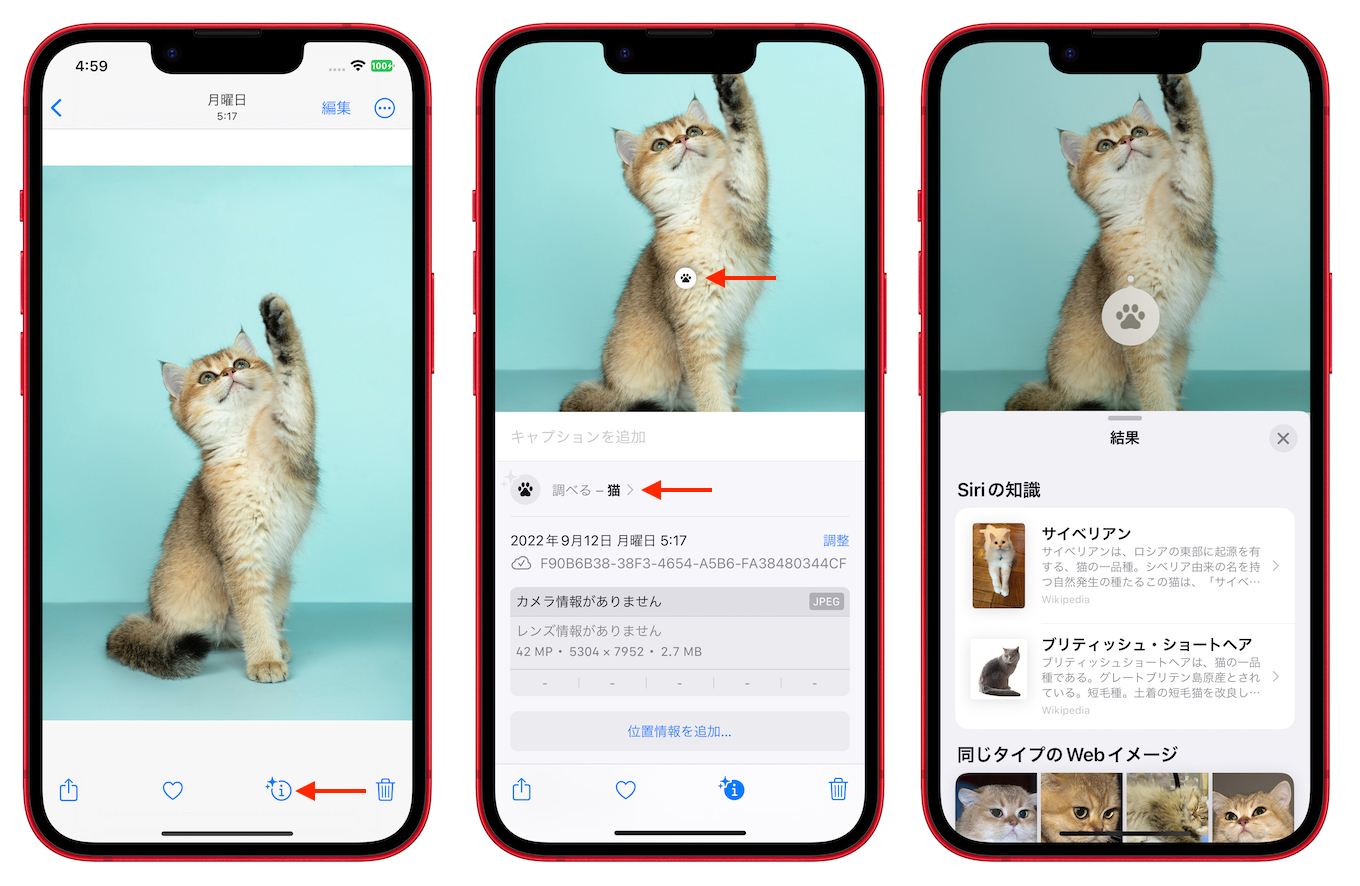

日本でVisual Look Upを使うには、iOS 16へアップグレードされたA12 Bionicを搭載したiPhone XS/XR以降のiPhoneが必要で、システム要件を満たし、そのオブジェクトがVisual Look Upで検索可能ならば、写真アプリの情報アイコン(ℹ️)にキラメキ(Sparkle)が付いたり、メニューに[調べる]が表示されます。

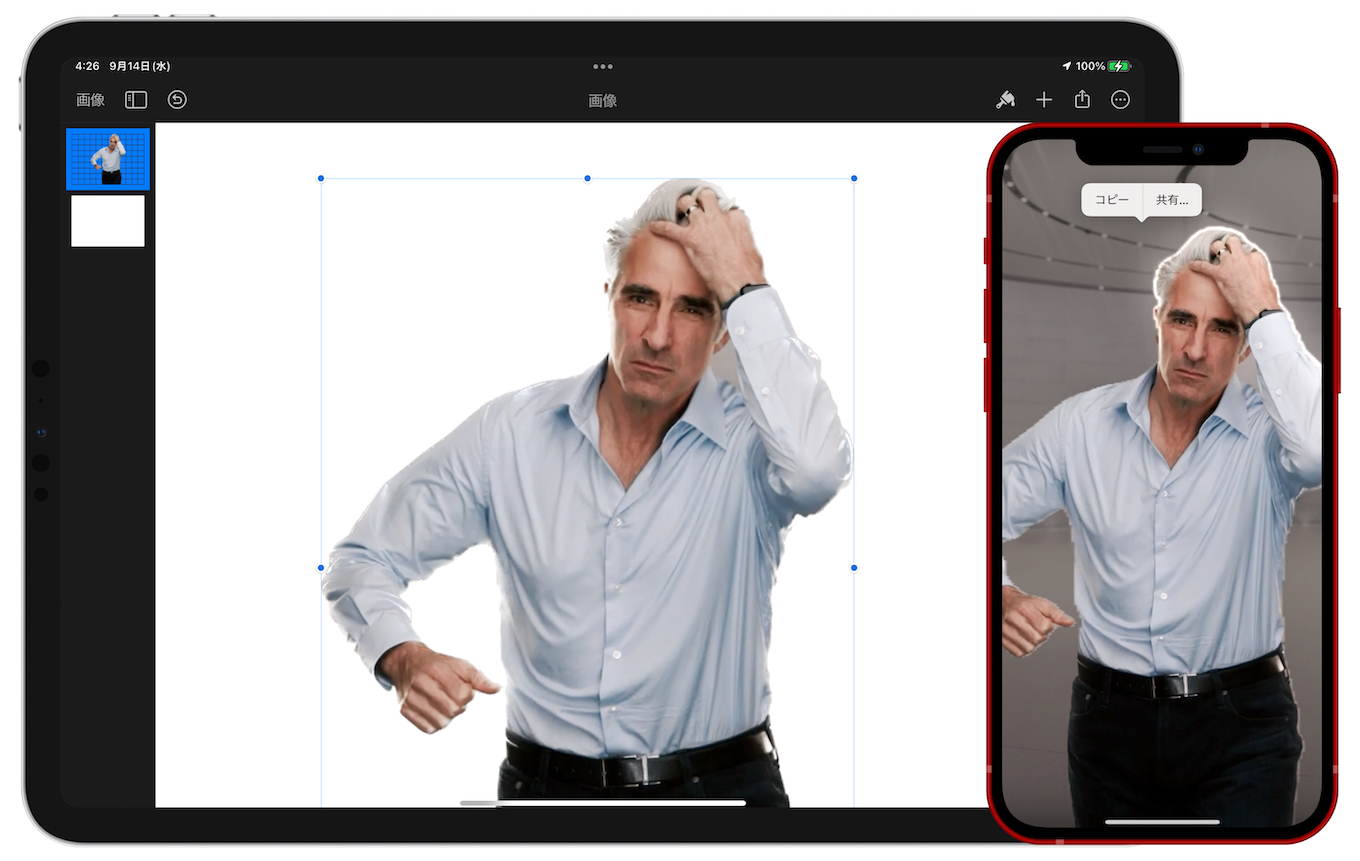

後は、そのアイコン/メニューをタップするだけで、AndroidのGoogleレンズの様に犬や猫の種類、植物の名前、有名なアートや本のタイトル、建物の詳細が表示されるようになっています。

また、AppleはiOS 16でVisual Look Upをアップデートし、鳥や昆虫、クモ、像の学習データを追加したそうなので、分からない鳥や虫がいたら写真で撮影して調べてみてください。

Visual Look Upで表示された結果が必ず正しいとは限りません。また、利用するにはSpotlightのSiriからの提案やイメージ検索が有効になっている必要があります。

- iOS 16/iPadOS 16の新機能まとめ (準備中)

コメント