次期macOS/iOSに搭載されるAppleの写真アプリは4000以上のシーンやオブジェクトを判別可能になるようです。詳細は以下から。

![]()

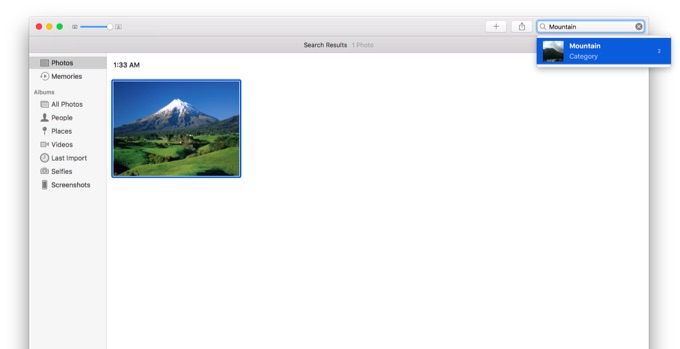

WWDC 2016の中でAppleのSVP Craig Federighi氏は次期macOS/iOSの写真アプリはディープラーニングを用いた画像検出機能が利用できると発表しましたが、中国のKay Yinさんが写真アプリを解析した結果、この写真アプリは4000以上のシーンやオブジェクト , 思い出, 人物の表情などを判断することが可能になっているようです。

Photos app supports detecting 4,432 different scenes and objects. These scenes or objects can be searched for in all languages.

Behind Apple’s Advanced Computer Vision for Photos app — Medium

macOS 10.12 Sierra Developer Beta版の写真アプリで利用可能なキーワードは以下の通りで、一度写真アプリが解析を行うと例えば”Maho“というビーチに行った時の写真を検索したい時も”Maho”というメタデータを登録せず、写真アプリがその場所を知らなくてもビーチの写真が抽出されるそうです。

- 人物の表情:微笑み, 驚き, 嫌悪など7つ

- 思い出:週末, 大衆, 誕生日, お祝い, 旅行など33カテゴリー

- シーンやオブジェクト:山/海, 空港, 車, 料理など153カテゴリー,4432オブジェクト

これは写真アプリが内蔵された辞書から”Maho”を検索し、その結果”Maho is a beach in Saint Martin”から”Maho”=ビーチと認識するからで、Appleはこのノードベースのデータマイニング技術によりGoogle Photosと同様の機能を写真アプリに実装するようです。

Apple’s implementation of node-based mining of photos and generation of knowledge graphs are also uniquely interesting. As time goes on, I look forward to discovering more about what’s behind the scenes.

*Neural NetworkおよびDeep LearningについてはWWDC 2017のセッション715にて詳しく説明されています。

コメント

もっと先にやる事があるような気がするけどな。もっと先に。

もっと先に、なに?